本文摘自雷锋网,原文链接:https://www.leiphone.com/category/academic/zgRQOYpPhqRUK1lH.html,侵删。

机器学习正在并且也将变得无处不在。

编译丨杏花、莓酊、王晔

又是一年一度的谷歌年度盘点,Jeff Dean再次执笔,为我们回顾过去一年来谷歌在5大方向的研究进展以及未来趋势。

Jeff Dean表示,“在过去几十年里,我们见证了机器学习和计算机科学领域的许多重大变化。早期方法的失效促进了现代方法的诞生,并被证明非常有效。”

按照这种发展模式,他认为,我们将在未来几年内见证一些“令人兴奋的进展”,这些进展最终将造福数十亿人的生活,产生比以往任何时候都更大的影响。

在这篇文章中,Jeff Dean重点介绍了机器学习有望产生此等影响的五个方面。对于每个方面,他将讨论谷歌相关的研究(主要是从2021年开始),以及在未来几年可能出现的新方向和新进展。

这些方面分别涉及了算法、效率、个性化、全球化、责任:

算法上,基于Transformer的大规模预训练模型如今无论是在单模态数据的多任务通用性,以及多模态联合学习的能力上,都证明了自身的潜力;

效率上,从算力到模型训练、部署,机器学习流水线的效率正不断提高;在模型运行方面,编译器的改进和加速器软件的优化也提供了很大的助力;而架构方面的改进,自动化机器学习的持续发展、以及对模型稀疏性的利用,都让算法研究发展迅速;

个性化上,机器学习不仅应用变得更加广泛,而且越来越人性化,在功能上越来越自然,同时也更加注重隐私保护;

全球化上,机器学习的影响范围越来越广阔,涉及到愈发多样的全球性问题,比如科学研究、医疗、芯片设计、碳排放缓解、自然灾害预防等等;

最后是责任,尽管饱受争议,但Jeff Dean表示,谷歌对于AI公平性非常重视,并从数据、算法、传播分析、模型可解释性、文化差异性研究以及大模型隐私保护上做了大量工作。

可以说,机器学习正在并且也将变得无处不在。

以下是关于五大趋势总结的编译介绍:

1 趋势1:功能更强大、更通用的机器学习模型

如今,研究者正在训练比以往任何时候都更大型、功能更强大的机器学习模型。

例如,仅在最近几年,语言领域的模型规模已经从在数百亿个数据标记上训练的数十亿个参数(例如,11B 参数的T5模型),发展到在数万亿个数据标记上训练的数百亿参数(例如,密集模型如 OpenAI 的 175B 参数 GPT-3 模型和 DeepMind 的 280B 参数 Gopher 模型,以及稀疏模型如 Google 的 600B 参数 GShard 模型和 1.2T 参数 GLaM 模型)。

数据集和模型规模的增强,使得各种语言任务的准确性显著提高,正如标注自然语言处理(NLP)基准任务的全面提升所表明的那样(例如对语言模型和机器翻译模型的神经标度定律的研究所预测的)。

上述大部分高级模型都专注于书面语言的单一但不可或缺的模态数据,并在语言理解基准和开放式对话能力方面展现出最先进的成果,甚至在一个领域中的多个任务中也具有如此表现。

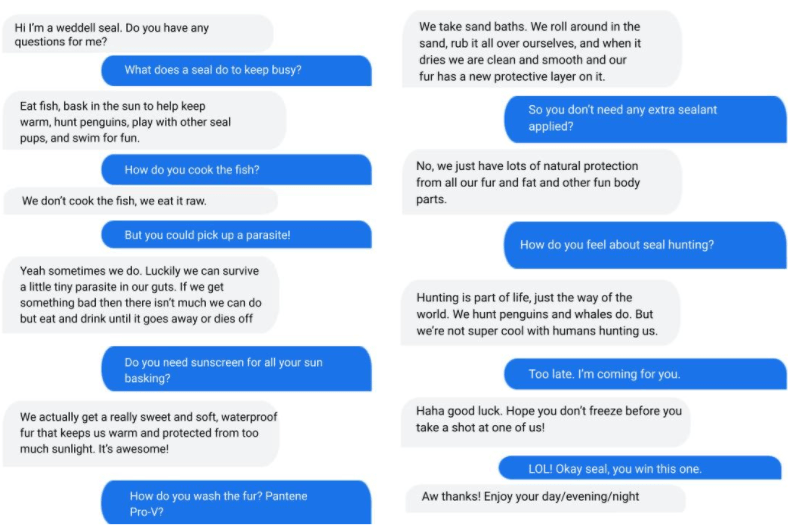

此外,它们还表现出令人兴奋的能力,可以在训练数据相对较少的情况下推广到新的语言任务。某些情况下,新任务的训练示例很少甚至没有。例如,NLP中的改进长问答、零标签学习任务。谷歌还提出了LaMDA模型,该模型展示了一种复杂的能力,可以进行开放式对话,在多轮对话中保持重要的上下文联系。

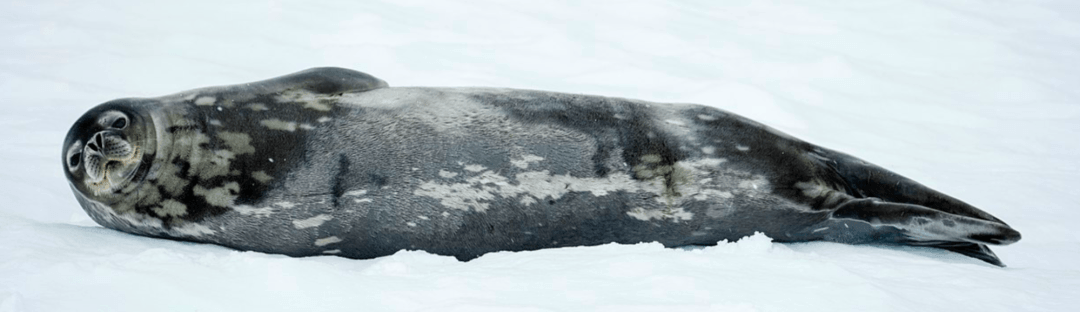

图注:“与 LaMDA 的对话,通过预设真实提示模仿威德尔海豹,“嗨,我是威德尔海豹。你有什么问题要问我吗?” 该模型在很大程度上保持了对话的角色特征。

Transformer 模型也对图像、视频和语音模型产生了重大影响,正如视觉 Transformer 模型的标度定律所预测的那样,所有这些任务也都从规模扩展中受益匪浅。

用于图像识别和视频分类的Transformer在许多基准上都取得了最先进的成果,谷歌还证明,与单独使用视频数据相比,在图像数据和视频数据上的联合训练模型可以提高视频任务的性能。

他们为图像和视频Transformer开发了稀疏的轴向注意力机制,可以更有效地使用计算,为视觉Transformer模型找到更好的标记图像方法,并通过检查视觉Transformer方法与卷积神经网络的操作方式相比,提高了对视觉Transformer方法的理解。将Transformer模型与卷积运算相结合,已在视觉和语音识别任务中显示出显著的优越性。

生成模型的输出质量也在大幅提高,这在图像的生成模型中表现得最为明显。

例如,最近的模型已经证明,仅给定一个类别(例如,输入“爱尔兰塞特”或“有轨电车”)就可以创建逼真的图像,也可以通过修复低分辨率图像,以创建一个看起来自然的高分辨率匹配图像(例如,输入“计算机,增强!”),甚至可以创建任意大小的自然场景。

另一个例子是,可以将图像转换为一系列离散标记,然后可以使用自回归生成模型以高保真度合成这些标记。

图注:级联扩散模型的示例,该模型从给定类别生成新图像,然后将其用作种子来创建高分辨率示例:第一个模型生成低分辨率图像,其余模型对最终高分辨率图像执行上采样。

SR3 超分辨率扩散模型将低分辨率图像作为输入,并从纯噪声构建相应的高分辨率图像。

这些强大的功能背后,亦伴随着巨大的责任,因此谷歌表示会根据其 AI 原则仔细审查此类模型的潜在应用。

除了先进的单模态模型外,谷歌也开始注意大规模多模态模型的潜力。这些是迄今为止最先进的模型,因为它们可以接受多种输入模态(例如,语言、图像、语音、视频),并可以生成多种输出模态,例如,基于描述性的句子或段落生成图像,或用人类语言描述图像的视觉内容。

这是一个令人兴奋的方向,因为和现实世界一样,在多模态数据中有些东西更容易学习(例如,阅读并观看演示比仅仅阅读更有用)。因此,将图像和文本配对可以帮助完成多语言检索任务。并且,更好地理解如何将文本和图像输入配对,可以为图像描述任务带来更好的结果。

同样,对视觉和文本数据的联合训练也有助于提高视觉分类任务的准确性和鲁棒性,而对图像、视频和音频任务的联合训练可以提高所有模态的泛化性能。

此外还有一些迹象表明,自然语言可以用作图像处理的输入,告诉机器人如何与世界交互并控制其他软件系统,这预示着用户界面的开发方式可能会发生变化。这些模型处理的模态将包括语音、声音、图像、视频和语言,甚至可能扩展到结构化数据、知识图谱和时间序列数据。

这些模型通常使用自监督学习方法进行训练,其中模型从未经标记的“原始”数据的观察中学习,例如 GPT-3 和 GLaM 中使用的语言模型、自监督语音模型 BigSSL 、视觉对比学习模型 SimCLR 和多模态对比模型 VATT。自监督学习让大型语音识别模型得以达到之前的语音搜索自动语音识别 (ASR) 基准的准确度,同时仅使用 3% 的带注释训练数据。

这些趋势令人兴奋,因为它们可以大大减少为特定任务启用机器学习所需的工作量,并且由于使得在更具代表性的数据上训练模型变得更容易,这些数据更好地反映了不同的亚群、地区、语言,或其他重要的表示维度。

所有这些趋势都指向训练功能强大的通用模型的方向,这些模型可以处理多种数据模式,并解决成千上万个任务。通过构建稀疏性模型,使得模型中唯一被给定任务激活的部分,仅有那些为其优化过的部分,从而这些多模态模型可以变得高效。

Jeff Dean表示,在接下来的几年里,谷歌将基于Pathways架构追求这一愿景。

Pathways:谷歌正在努力的统一模型,可以泛化至数百万个任务。

2 趋势2:机器学习效率的持续提升

由于计算机硬件设计以及机器学习算法和元学习研究的进步,机器学习的效率得到持续提升,推动着机器学习模型的功能变得更加强大。

ML 流水线涉及许多方面,从训练和执行模型的硬件,到 ML 架构的各个组件,都可以进行效率优化,同时保持或提高整体性能。

与前几年相比,这些线程中的每一个都可以以显著的乘法因子提高效率,并且综合起来可以将计算成本(包括二氧化碳当量排放量)降低几个数量级。

更高的效率促成了许多关键的进步,这些进步将继续显著提高机器学习的效率,使更大、更高质量的机器学习模型能够以高效的方式开发,并进一步使访问公平化。

ML 加速器性能的持续改进

每一代 ML 加速器都在前几代的基础上进行了改进,使每个芯片的性能更快,并且通常可以扩大整个系统的规模。

此外,移动设备上的机器学习能力也在显着提高。Pixel 6 手机采用全新的 Google Tensor 处理器,该处理器集成了强大的 ML 加速器,以更好地支持重要的设备功能。

Jeff Dean表示,谷歌使用 ML 来加速各种计算机芯片的设计也带来了好处,特别是在生产更好的 ML 加速器方面。

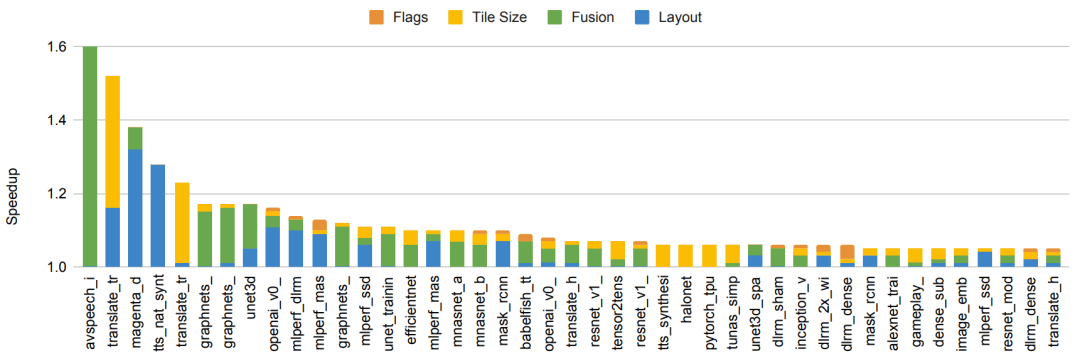

ML 编译和 ML 工作负载优化的持续改进

即使硬件不变,编译器的改进和机器学习加速器系统软件的其他优化也可以显著提高效率。

此外,GSPMD 描述了一种基于 XLA 编译器的自动并行化系统,该系统能够将大多数深度学习网络架构扩展到加速器的内存容量之外,并已应用于许多大型模型,例如 GShard-M4、LaMDA、BigSSL、ViT、MetNet -2 和 GLaM,在多个领域产生了最先进的成果。

图注:通过在 150 个 ML 模型上使用基于 ML 的编译器自动调整实现端到端模型加速。图中包括实现 5% 或更多改进的模型。条形颜色代表优化不同模型组件的相对改进。

人类创造的更高效模型架构

模型架构的持续改进大大减少了为许多问题实现给定精度水平所需的计算量。

例如,谷歌在 2017 年开发的 Transformer 架构能够提高在多个 NLP 基准上的当前最佳水平,同时使用比其他各种常用方法少 10 到 100 倍的计算来实现这些结果,例如 LSTM 和其他循环架构。

同样,尽管使用的计算量比卷积神经网络少 4 到 10 倍,但视觉 Transformer 能够在许多不同的图像分类任务上显示出改善的最先进结果。

机器驱动的更高效模型架构的发现

神经架构搜索(NAS)可以自动发现对给定问题域更有效的新 ML 架构。NAS 的一个主要优点是它可以大大减少算法开发所需的工作量,因为 NAS 只需要对每个搜索空间和问题域组合进行单次检验。

此外,虽然执行 NAS 的初始工作在计算上可能很昂贵,但由此产生的模型可以大大减少下游研究和生产设置中的计算,从而大大降低总体资源需求。

例如,发现 Evolved Transformer 的单次搜索仅产生了 3.2 吨二氧化碳当量(远低于其他地方报告的 284 吨二氧化碳当量),但产生了一个比普通的 Transformer 模型效率高 15-20%的模型。

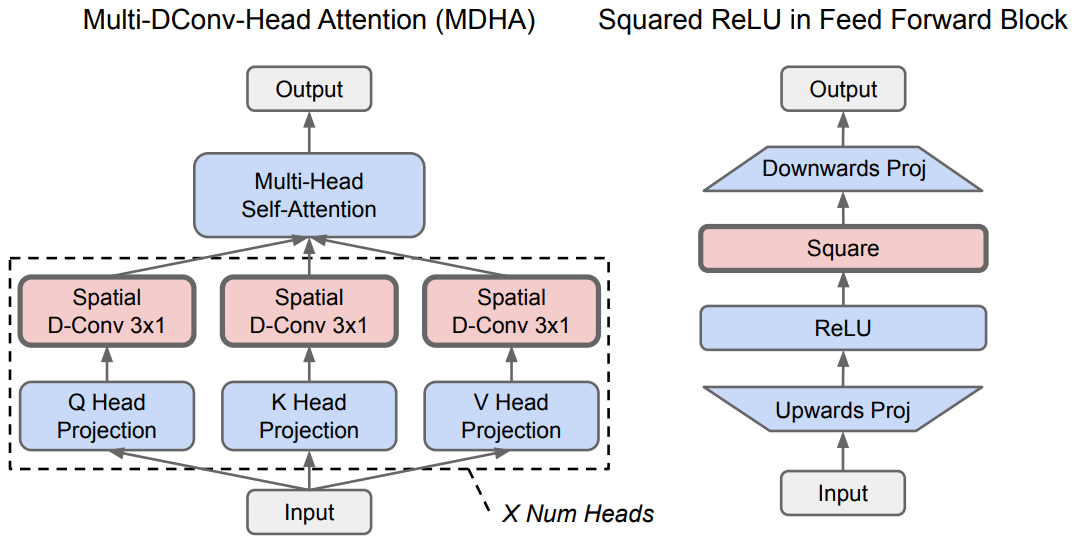

最近,谷歌利用 NAS 发现了一种更高效的架构,称为 Primer(也已开源),与普通的 Transformer 模型相比,它可以将训练成本降低 4 倍。通过这种方式,NAS 搜索的发现成本通常可以从使用发现的更有效的模型架构中收回,即使它们仅应用于少数下游任务(NAS 结果可被重复使用数千次)。

图注:NAS 发现的 Primer 架构的效率是普通 Transformer 模型的 4 倍。这张图片红色部分显示了 Primer 获得大部分改进的两个主要修改:添加到注意力多头投影的深度卷积和平方 ReLU 激活(蓝色表示原始 Transformer 的部分)。

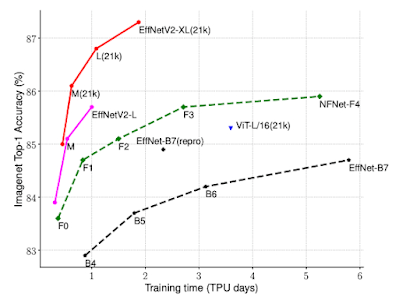

NAS还被用于在视觉领域发现更有效的模型。EfficientNetV2 模型架构是神经架构搜索的结果,它联合优化了模型精度、模型大小和训练速度。在 ImageNet 基准测试中,EfficientNetV2 将训练速度提高了 5 到 11 倍,同时与以前最先进的模型相比,模型参数大大减少。

CoAtNet 模型架构是通过架构搜索发现的,结合了视觉 Transformer 和卷积网络来创建一个混合模型架构,其训练速度比视觉 Transformer 快 4 倍,并实现了新的 ImageNet 最先进结果。

广泛使用搜索来帮助改进 ML 模型架构和算法,包括使用强化学习和进化技术,激发了其他研究人员将这种方法应用于不同领域。

除了模型架构之外,自动搜索还可用于寻找新的、更有效的强化学习算法,建立在早期的 AutoML-Zero 工作的基础上。

稀疏性模型具有非常大的容量,但对于给定的数据(示例或 token ),只有模型的某些部分被激活,这是另一个可以大大提高效率的重要算法进步。

2017 年,谷歌引入了稀疏门控混合专家层,该层在各种翻译基准上展示了更好的结果,同时使用的计算量比以前最先进的密集 LSTM 模型少 10 倍。

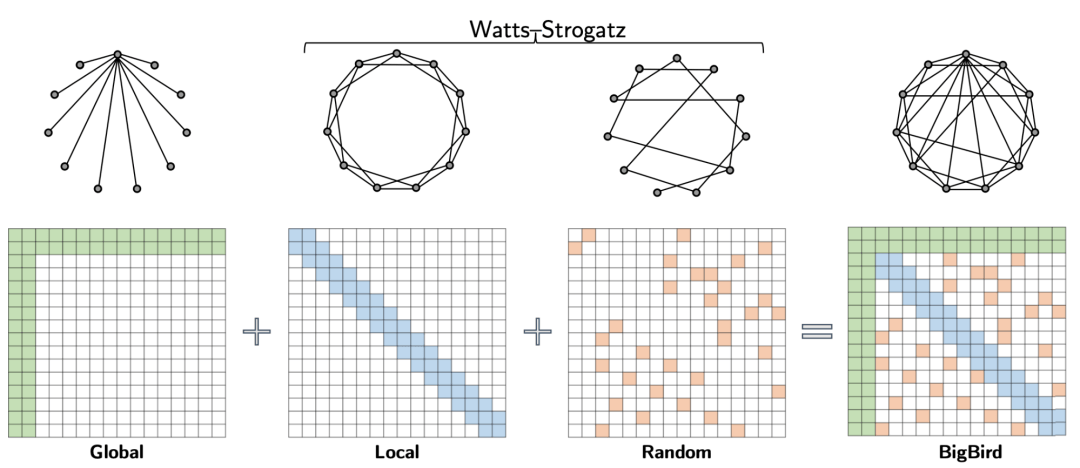

GLaM 模型表明,Transformer 和混合专家风格的层可以结合起来生成一个模型,该模型在 29 个基准测试中平均超过 GPT-3 模型的准确性,而训练的能耗减少了 3 倍,推理的计算量减少了 2 倍。稀疏性的概念也可以用于降低Transformer 架构中注意力机制的成本。

相关阅读 >>

360借条人工客服热线电话号码(已更新2023)万飙:荣耀智能终端工厂让手机生产的自动化率达

【滔哥漫看】作诗、作词、作文样样会,人工智能会不会淘汰作家?

12/1传说对决 aic-2021 one 对上 泰国dtn// 明天12/2的ag

更多相关阅读请进入《谷歌》频道 >>